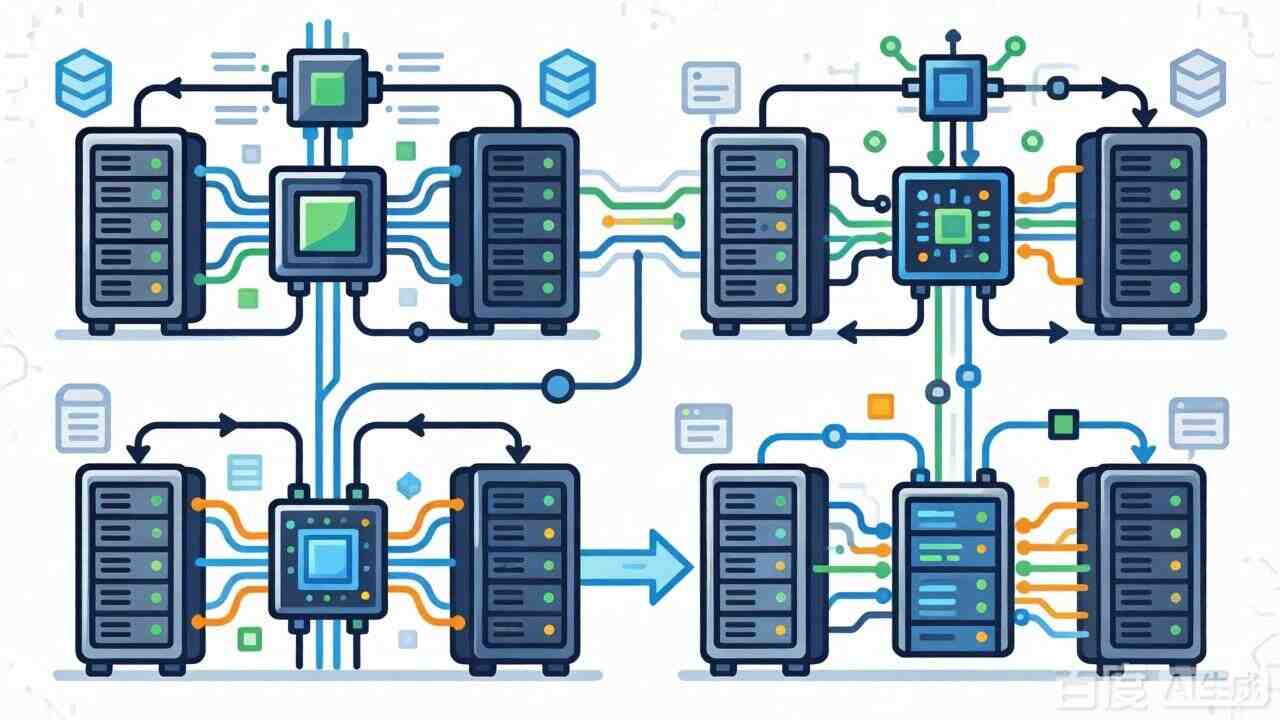

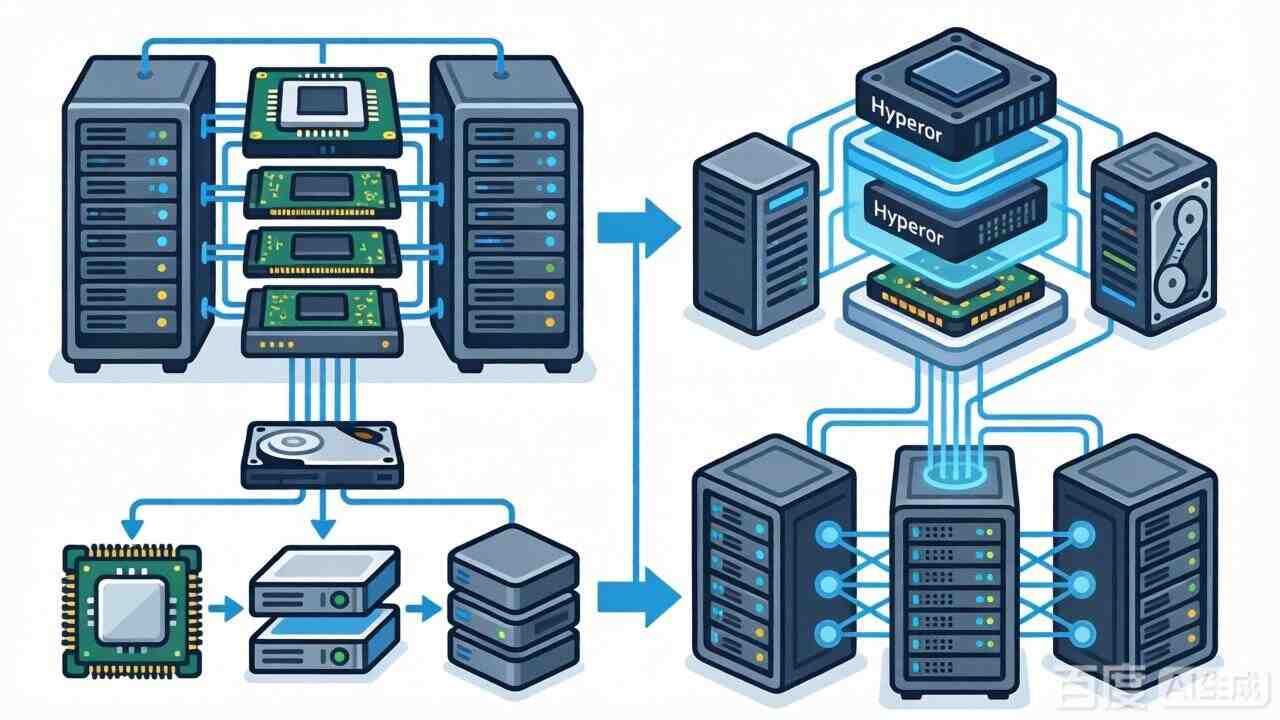

美国服务器的现代化IT基础设施中,虚拟化技术已成为资源整合、运维自动化和服务交付转型的基石。虚拟化的本质是通过软件抽象层(Hypervisor)将物理美国服务器的计算、存储、网络资源池化,并在此之上创建和管理多个隔离的、可独立运行的虚拟机实例。这一技术革命性地改变了美国服务器数据中心的运营模式,从传统的"一机一应用"转变为高效的资源多租户共享,显著提升了硬件利用率、部署灵活性和灾难恢复能力。从Type 1 Hypervisor的裸机虚拟化,到容器化带来的应用级虚拟化,再到基于Kubernetes的云原生编排,虚拟化技术栈不断演进,深度重塑了美国服务器的工作负载部署范式。本文小编将系统解析虚拟化的核心架构,并提供从KVM部署到管理自动化的完整实战指南。

Type 1 Hypervisor:直接安装在物理美国服务器硬件上,也称为"裸机虚拟化"。代表产品:VMware ESXi、Microsoft Hyper-V、KVM(当以内核模块形式存在时)、Xen。它直接控制硬件资源,性能损耗最低(通常1-5%),是企业级美国服务器的首选。

Type 2 Hypervisor:作为应用程序运行在宿主操作系统之上。代表产品:VMware Workstation、Oracle VirtualBox、QEMU。适用于美国服务器开发、测试环境,性能损耗较高。

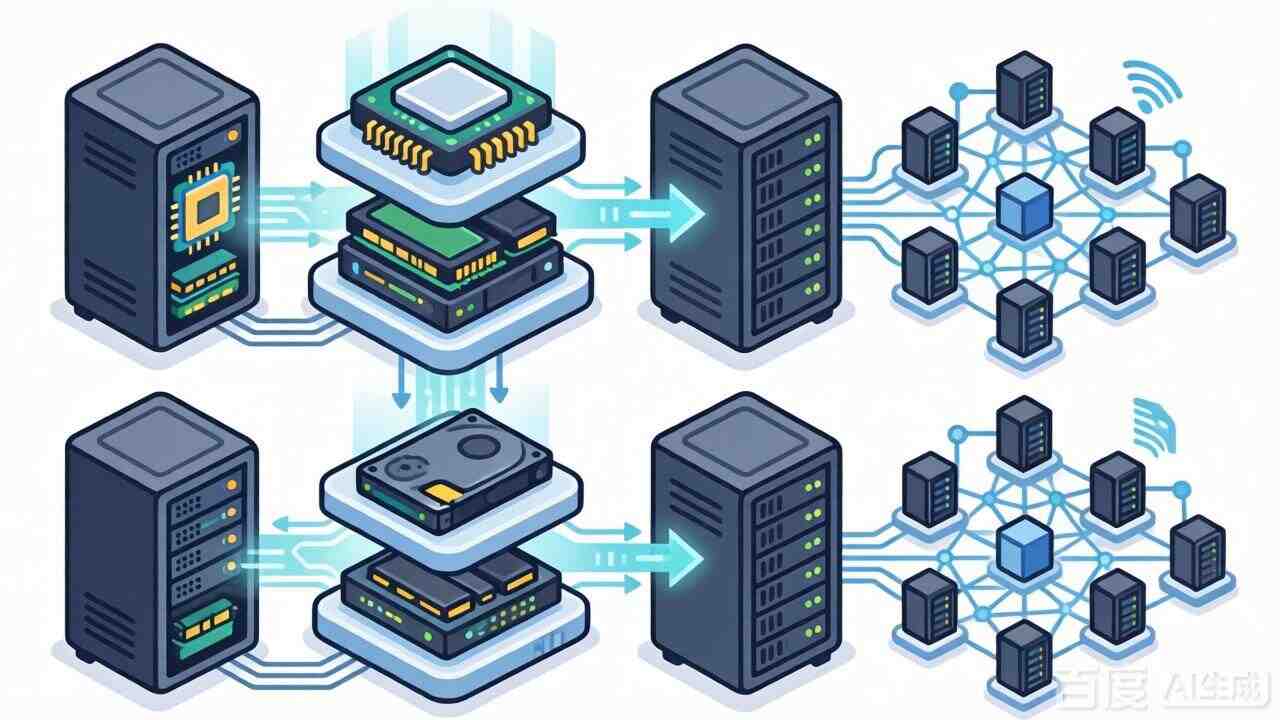

CPU虚拟化:通过Intel VT-x或AMD-V硬件辅助虚拟化技术,使美国服务器虚拟机能够直接执行特权指令。KVM利用此技术实现接近原生性能。

内存虚拟化:使用美国服务器影子页表或EPT/RVI技术,高效映射虚拟机物理地址到宿主机物理地址。

I/O虚拟化:SR-IOV技术允许单个物理网卡或HBA卡虚拟出多个独立的虚拟功能,直接分配给美国服务器虚拟机,大幅降低I/O延迟。

存储虚拟化:将物理存储资源抽象为美国服务器虚拟磁盘文件(如QCOW2、VMDK、VHD)或直通LUN。

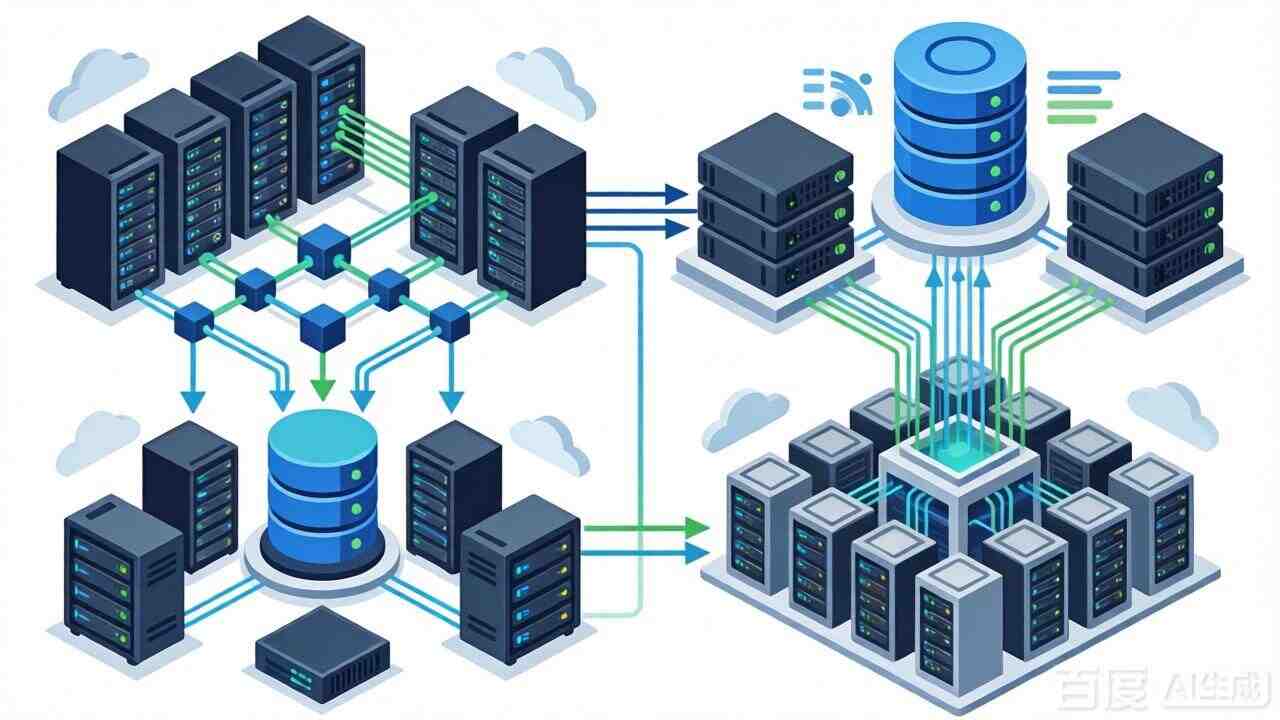

虚拟化是系统级隔离,每个VM包含完整操作系统;容器化是进程级隔离,共享宿主机内核。美国服务器容器(Docker)更轻量、启动更快,但隔离性较弱。两者常结合使用:VM提供强隔离的"硬边界",容器在VM内提供应用便携性。

以下以在美国服务器上部署KVM虚拟化平台为例,详述从环境准备到自动化管理的全流程。

确保美国服务器CPU支持虚拟化扩展,并在BIOS中启用。检查网络和存储配置。

安装KVM内核模块、QEMU模拟器和libvirt管理框架。

配置美国服务器虚拟网络,可选择NAT、桥接或SR-IOV直通模式。

创建基于目录、LVM或美国服务器网络存储的虚拟磁盘存储池。

配置虚拟机快照、克隆、迁移和美国服务器资源限制。

部署美国服务器监控工具,实现虚拟机生命周期自动化管理。

egrep -c '(vmx|svm)' /proc/cpuinfo # 输出大于0表示支持 # 检查内核模块 lsmod | grep kvm # 对于Intel CPU还应检查 grep -E "(vmx|svm)" /proc/cpuinfo

sudo apt update sudo apt install -y qemu-kvm libvirt-daemon-system libvirt-clients bridge-utils virtinst virt-manager cpu-checker # 安装额外工具 sudo apt install -y libguestfs-tools libosinfo-bin virt-top

sudo kvm-ok # 应显示"KVM acceleration can be used" sudo systemctl is-active libvirtd # 应显示active

sudo usermod -aG libvirt $USER sudo usermod -aG kvm $USER # 重新登录使组生效

sudo apt install -y virtio-win

# 编辑网络配置文件 sudo nano /etc/netplan/00-installer-config.yaml # 示例配置(替换原有配置): network: version: 2 ethernets: eno1: dhcp4: false bridges: br0: interfaces: [eno1] addresses: [192.168.1.100/24] gateway4: 192.168.1.1 nameservers: addresses: [8.8.8.8, 1.1.1.1] parameters: stp: false forward-delay: 0 # 应用配置 sudo netplan apply

sudo virsh net-list --all # 默认有一个名为default的NAT网络

sudo virsh net-define /dev/stdin <<EOF <network> <name>vm-network</name> <forward mode='nat'> <nat> <port start='1024' end='65535'/> </nat> </forward> <bridge name='virbr1' stp='on' delay='0'/> <ip address='192.168.100.1' netmask='255.255.255.0'> <dhcp> <range start='192.168.100.100' end='192.168.100.200'/> </dhcp> </ip> </network> EOF # 启动并设为自启动 sudo virsh net-start vm-network sudo virsh net-autostart vm-network

# 查看网卡SR-IOV能力 sudo lspci -v | grep -i sriov # 启用VF echo 8 | sudo tee /sys/class/net/enp3s0f0/device/sriov_numvfs

sudo mkdir -p /var/lib/libvirt/images sudo virsh pool-define-as default dir - - - - "/var/lib/libvirt/images" sudo virsh pool-build default sudo virsh pool-start default sudo virsh pool-autostart default

# 首先准备物理卷和卷组 sudo pvcreate /dev/sdb sudo vgcreate vg_vms /dev/sdb # 定义存储池 sudo virsh pool-define-as vmpool logical - - /dev/vg_vms - /dev/vg_vms sudo virsh pool-build vmpool sudo virsh pool-start vmpool sudo virsh pool-autostart vmpool

sudo virsh pool-define-as nfspool netfs - - nfs.example.com:/path/to/share - /mnt/nfs sudo virsh pool-build nfspool sudo virsh pool-start nfspool

sudo virsh pool-list --all --details

sudo virt-install \ --name ubuntu-server \ --ram 2048 \ --vcpus 2 \ --disk path=/var/lib/libvirt/images/ubuntu-server.qcow2,size=20 \ --os-type linux \ --os-variant ubuntu22.04 \ --network bridge=br0 \ --graphics vnc,listen=0.0.0.0 \ --noautoconsole \ --location /path/to/ubuntu-22.04-live-server-amd64.iso

sudo virt-install \ --name existing-vm \ --ram 1024 \ --vcpus 1 \ --import \ --disk /path/to/existing-disk.qcow2 \ --network network=default

sudo nano /tmp/vm.xml # 内容示例: <domain type='kvm'> <name>custom-vm</name> <memory unit='KiB'>1048576</memory> <vcpu placement='static'>2</vcpu> <os> <type arch='x86_64' machine='pc-q35-6.2'>hvm</type> <boot dev='hd'/> </os> <devices> <disk type='file' device='disk'> <driver name='qemu' type='qcow2'/> <source file='/var/lib/libvirt/images/custom-vm.qcow2'/> <target dev='vda' bus='virtio'/> </disk> <interface type='network'> <source network='default'/> <model type='virtio'/> </interface> </devices> </domain> # 定义并启动 sudo virsh define /tmp/vm.xml sudo virsh start custom-vm

# 列出所有虚拟机 sudo virsh list --all # 启动/关闭/重启 sudo virsh start vm-name sudo virsh shutdown vm-name sudo virsh reboot vm-name # 强制关闭 sudo virsh destroy vm-name # 删除虚拟机 sudo virsh undefine vm-name --remove-all-storage # 控制台连接 sudo virsh console vm-name

# 创建内部快照(保存到磁盘文件) sudo virsh snapshot-create-as vm-name snapshot1 "First snapshot" # 创建外部快照 sudo virsh snapshot-create-as vm-name external-snap --disk-only --atomic # 列出快照 sudo virsh snapshot-list vm-name # 恢复快照 sudo virsh snapshot-revert vm-name snapshot1 # 删除快照 sudo virsh snapshot-delete vm-name snapshot1

sudo virt-clone \ --original vm-name \ --name vm-clone \ --file /var/lib/libvirt/images/vm-clone.qcow2

# 修改内存(需关机) sudo virsh setmaxmem vm-name 4G --config sudo virsh setmem vm-name 4G --config # 修改CPU数量 sudo virsh setvcpus vm-name 4 --config # 在线调整(需客户机支持) sudo virsh setvcpus vm-name 4 --live sudo virsh setmem vm-name 4G --live

# 共享存储迁移 sudo virsh migrate --live vm-name qemu+ssh://dest-host/system # 本地存储迁移 sudo virsh migrate --live --copy-storage-all vm-name qemu+ssh://dest-host/system

# 查看宿主机CPU拓扑 lscpu # 在虚拟机XML中添加: <cputune> <vcpupin vcpu='0' cpuset='0'/> <vcpupin vcpu='1' cpuset='1'/> <emulatorpin cpuset='0-1'/> </cputune>

# 配置宿主机 echo 1024 | sudo tee /proc/sys/vm/nr_hugepages # 在虚拟机XML中添加: <memoryBacking> <hugepages/> </memoryBacking>

# 磁盘添加cache=none,io=native <driver name='qemu' type='qcow2' cache='none' io='native'/> # 网络配置多队列 <model type='virtio'/> <driver name='vhost' queues='4'/>

# 使用virt-top sudo virt-top # 使用性能监控 sudo virsh domstats vm-name

sudo virt-install \ --name cloud-vm \ --ram 1024 \ --vcpus 1 \ --disk path=/var/lib/libvirt/images/cloud-vm.qcow2,size=10 \ --os-type linux \ --os-variant ubuntu22.04 \ --import \ --cloud-init user-data=/path/to/user-data.yml

# 安装terraform

sudo apt install terraform

# 创建terraform配置文件

# main.tf

provider "libvirt" {

uri = "qemu:///system"

}

resource "libvirt_volume" "ubuntu" {

name = "ubuntu.qcow2"

pool = "default"

source = "https://cloud-images.ubuntu.com/jammy/current/jammy-server-cloudimg-amd64.img"

format = "qcow2"

}

resource "libvirt_domain" "vm" {

name = "terraform-vm"

memory = "1024"

vcpu = 1

disk {

volume_id = libvirt_volume.ubuntu.id

}

network_interface {

network_name = "default"

}

}

# 应用配置

terraform init

terraform plan

terraform apply

在美国服务器上实施虚拟化,是从物理硬件管理到逻辑资源服务的根本性转变。成功的虚拟化部署不仅需要正确安装和配置KVM等Hypervisor,更需要在网络架构、存储设计、性能优化和自动化运维等维度进行系统规划。通过上述命令和最佳实践,可以将物理美国服务器的利用率从传统的10-20%提升至60-80%,同时获得快速部署、弹性伸缩、高可用性和简化备份等关键能力。随着云原生技术的发展,虚拟化并未过时,而是演变为容器平台的基础设施层,为微服务架构提供稳定可靠的运行环境。记住,虚拟化的真正价值不在于技术本身,而在于它如何赋能业务敏捷性、降低TCO,并为美国服务器的数字化转型奠定坚实基础。

现在梦飞科技合作的美国VM机房的美国服务器所有配置都免费赠送防御值 ,可以有效防护网站的安全,以下是部分配置介绍:

| CPU | 内存 | 硬盘 | 带宽 | IP | 价格 | 防御 |

| E3-1270v2 | 32GB | 500GB SSD | 1G无限流量 | 1个IP | 350/月 | 免费赠送1800Gbps DDoS防御 |

| Dual E5-2690v1 | 32GB | 500GB SSD | 1G无限流量 | 1个IP | 799/月 | 免费赠送1800Gbps DDoS防御 |

| Dual E5-2690v2 | 32GB | 500GB SSD | 1G无限流量 | 1个IP | 999/月 | 免费赠送1800Gbps DDoS防御 |

| Dual Intel Gold 6152 | 128GB | 960GB NVME | 1G无限流量 | 1个IP | 1299/月 | 免费赠送1800Gbps DDoS防御 |

梦飞科技已与全球多个国家的顶级数据中心达成战略合作关系,为互联网外贸行业、金融行业、IOT行业、游戏行业、直播行业、电商行业等企业客户等提供一站式安全解决方案。持续关注梦飞科技官网,获取更多IDC资讯!