美国服务器在高并发、高可用架构中,软件负载均衡器是实现水平扩展、故障转移和性能优化的核心枢纽。与昂贵的硬件负载均衡设备不同,软件负载均衡(如Nginx、HAProxy、Envoy、Traefik)在通用美国服务器上通过软件实现,以其成本效益、配置灵活性和强大的可编程性,成为现代云原生和混合架构的首选。其工作原理并非简单的“流量均分”,而是依据复杂算法、实时健康检查和细粒度策略,智能地将来自全球用户的连接请求分发到后端多个美国服务器实例,从而构建一个对外表现为单一、稳定服务的虚拟实体。本文小编将深入剖析软件负载均衡的核心工作机制,并提供从美国服务器部署、配置到优化的全链路实战指南。

软件负载均衡器工作在美国服务器OSI模型的不同层次,决定了其决策的智能化程度:

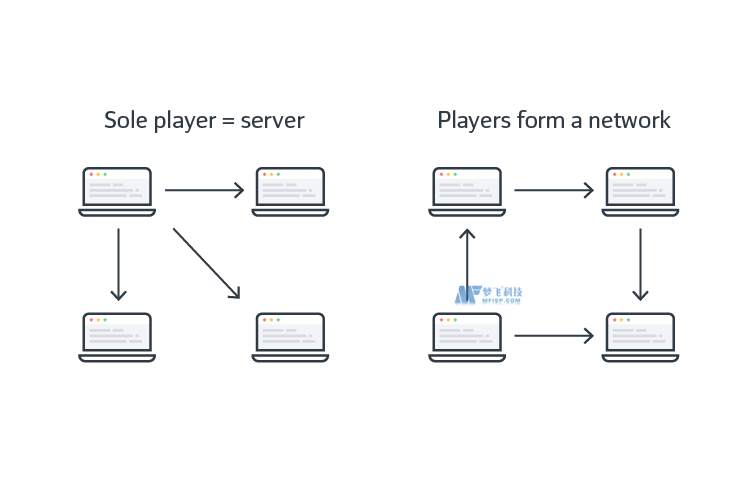

四层负载均衡:基于传输层(TCP/UDP)信息,如源/目标IP地址、端口号。它不解析应用层数据包内容,仅根据简单的四层信息进行快速转发。适用于美国服务器非HTTP协议(如数据库、游戏、自定义TCP服务)或需要高性能转发的场景。代表:LVS、HAProxy的TCP模式、Nginx的stream模块。

七层负载均衡:基于应用层(HTTP/HTTPS, gRPC)信息。它能深度解析HTTP头部、URL路径、Cookie、甚至请求体,从而做出更智能的路由决策。适用于美国服务器Web应用、API网关、灰度发布、A/B测试等场景。代表:Nginx的http模块、HAProxy的HTTP模式、Envoy。

加权轮询:根据美国服务器性能分配不同权重,性能高的服务器获得更多请求。

最少连接:将新请求发送给当前活跃连接数最少的美国服务器,实现负载均衡。

源IP哈希:根据客户端IP地址计算哈希值,将同一IP的请求始终发送到同一后端美国服务器。这是实现会话保持的简单方法,但可能导致负载不均。

一致性哈希:对请求的某个键(如URL、参数)进行哈希,确保相同键的请求总是落到同一美国服务器,且在服务器列表变化时,重映射的请求最少,对缓存友好。

这是高可用的生命线。负载均衡器持续向后端美国服务器发送探测请求(如TCP连接尝试、HTTP GET请求特定健康检查端点)。如果美国服务器在连续多次检查中失败,则被标记为不健康,并从后端池中自动剔除,新请求不再发往该服务器。当美国服务器恢复健康后,又会被自动重新加入。

对于有状态的应用(如购物车),需要确保同一用户的多次请求落到同一后端美国服务器。七层负载均衡器可通过插入或识别特定的会话Cookie(如JSESSIONID)来实现。

以下以在美国服务器上部署Nginx作为七层负载均衡器为例,详述从安装到高级配置的完整流程。

1、确定后端服务器:准备2台或以上运行相同应用的后端美国服务器(如IP: 10.0.1.10, 10.0.1.11)。

2、规划负载均衡器:准备一台性能较好的独立美国服务器作为负载均衡器(LB)。为高可用,可部署两台LB并配置Keepalived实现VIP漂移。

在负载均衡器的美国服务器上安装Nginx,并配置基础的Upstream和Server模块。

启用主动健康检查,并根据美国服务器应用需要配置会话保持策略。

配置美国服务器SSL终止、访问控制、速率限制、连接池优化等。

配置第二台负载均衡器,通过Keepalived实现主备切换,消除美国服务器单点故障。

# Ubuntu/Debian:

sudo apt update

sudo apt install nginx -y

# CentOS/RHEL:

sudo yum install epel-release -y

sudo yum install nginx -y

# 验证安装:

nginx -v

sudo nano /etc/nginx/conf.d/loadbalancer.conf

添加以下配置:

# 定义后端服务器组,名为 backend_servers:

upstream backend_servers {

# 使用加权轮询算法,weight值越高分配请求越多

server 10.0.1.10 weight=3;

server 10.0.1.11 weight=2;

server 10.0.1.12 weight=1;

# 可选的负载均衡算法指令(默认是加权轮询):

# least_conn; # 最少连接

# ip_hash; # 源IP哈希(用于会话保持)

# hash $request_uri consistent; # 一致性哈希,基于请求URI

}

# 配置HTTP服务器块:

server {

listen 80;

server_name yourdomain.com; # 替换为您的域名

location / {

# 核心代理指令,将所有请求转发到后端服务器组

proxy_pass http://backend_servers;

# 设置必要的代理头,将客户端真实信息传递给后端

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

proxy_set_header X-Forwarded-Proto $scheme;

# 连接超时设置

proxy_connect_timeout 5s;

proxy_send_timeout 60s;

proxy_read_timeout 60s;

# 启用被动健康检查:当连接后端失败时,标记该后端为不可用,并尝试下一个

proxy_next_upstream error timeout http_500 http_502 http_503 http_504;

proxy_next_upstream_tries 3;

}

}

# 测试配置语法并重载Nginx:

sudo nginx -t

sudo systemctl reload nginx

在 upstream 块中启用主动健康检查(Nginx Plus 功能,开源版可通过第三方模块或被动检查实现):

upstream backend_servers {

server 10.0.1.10 max_fails=3 fail_timeout=30s;

server 10.0.1.11 max_fails=3 fail_timeout=30s;

# 参数解释:

# max_fails: 在fail_timeout时间内,失败次数达到此值,则标记服务器不可用。

# fail_timeout: 服务器被标记为不可用的时间,以及计算失败次数的时间窗口。

}

# 对于开源Nginx,可通过在location中定义特定的健康检查端点,并结合脚本实现:

location /health {

# 这是一个简单的健康检查端点,返回200 OK

access_log off;

return 200 "healthy\n";

add_header Content-Type text/plain;

}

使用第三方工具(如nginx_upstream_check_module)进行主动TCP/HTTP健康检查:

# 编译安装带此模块的Nginx,配置示例:

upstream backend_servers {

server 10.0.1.10;

server 10.0.1.11;

check interval=3000 rise=2 fall=5 timeout=1000 type=http;

check_http_send "HEAD /health HTTP/1.0\r\n\r\n";

check_http_expect_alive http_2xx http_3xx;

}

upstream backend_servers {

ip_hash; # 注意:此指令与weight参数不兼容

server 10.0.1.10;

server 10.0.1.11;

}

方法2:使用Nginx的sticky cookie(需要商业版Nginx Plus)

# upstream backend_servers {

# sticky cookie srv_id expires=1h domain=.yourdomain.com path=/;

# server 10.0.1.10;

# server 10.0.1.11;

# }

方法3:在应用层实现(推荐)。由应用美国服务器设置包含自身标识的Cookie(如JSESSIONID),

# 负载均衡器通过识别此Cookie进行路由。Nginx配置:

upstream backend_servers {

hash $cookie_jsessionid; # 基于JSESSIONID Cookie进行哈希

server 10.0.1.10;

server 10.0.1.11;

}

在美国服务器负载均衡器上终止SSL,后端使用HTTP,减轻后端压力:

server {

listen 443 ssl http2; # 启用HTTP/2

server_name yourdomain.com;

ssl_certificate /etc/ssl/certs/yourdomain.crt;

ssl_certificate_key /etc/ssl/private/yourdomain.key;

ssl_protocols TLSv1.2 TLSv1.3;

ssl_ciphers HIGH:!aNULL:!MD5;

location / {

proxy_pass http://backend_servers; # 注意这里是http,不是https

proxy_set_header Host $host;

proxy_set_header X-Forwarded-Proto https; # 重要:告诉后端这是HTTPS请求

# ... 其他proxy_set_header

}

}

server {

listen 80;

server_name yourdomain.com;

return 301 https://$server_name$request_uri;

}

# 在nginx.conf的http块中优化

http {

# 启用连接复用

keepalive_timeout 65;

keepalive_requests 100;

# 调整缓冲区

client_body_buffer_size 128k;

client_max_body_size 10m;

# 启用Gzip压缩

gzip on;

gzip_types text/plain text/css application/json application/javascript text/xml application/xml application/xml+rss text/javascript;

# 限制连接速率防止滥用

limit_conn_zone $binary_remote_addr zone=addr:10m;

limit_req_zone $binary_remote_addr zone=one:10m rate=10r/s;

# 在主server或location中应用限制

server {

location / {

limit_conn addr 10; # 每个IP最多10个连接

limit_req zone=one burst=20 nodelay; # 每秒最多10请求,允许突发20个

# ... proxy_pass

}

}

}

部署于美国服务器的软件负载均衡器,本质上是构建了一个智能的流量调度与治理平面。它通过多层次的决策逻辑(算法、健康状态、会话信息),将离散的后端服务器群整合为一个弹性、高可用的统一服务。从基础的加权轮询,到精细的七层路由、自动化的故障隔离,再到美国服务器SSL终止和安全加固,每一个配置项都直接影响着整个系统的性能、稳定性和安全性。通过深入理解Nginx等工具的核心机制,并结合美国服务器实际的业务流量模式和故障场景进行调优,可以构建出一个能够从容应对突发流量、自动规避故障节点、并为全球用户提供稳定、快速访问体验的现代化负载均衡层。

现在梦飞科技合作的美国VM机房的美国服务器所有配置都免费赠送防御值 ,可以有效防护网站的安全,以下是部分配置介绍:

| CPU | 内存 | 硬盘 | 带宽 | IP | 价格 | 防御 |

| E3-1270v2 | 32GB | 500GB SSD | 1G无限流量 | 1个IP | 350/月 | 免费赠送1800Gbps DDoS防御 |

| Dual E5-2690v1 | 32GB | 500GB SSD | 1G无限流量 | 1个IP | 799/月 | 免费赠送1800Gbps DDoS防御 |

| Dual E5-2690v2 | 32GB | 500GB SSD | 1G无限流量 | 1个IP | 999/月 | 免费赠送1800Gbps DDoS防御 |

| Dual Intel Gold 6152 | 128GB | 960GB NVME | 1G无限流量 | 1个IP | 1299/月 | 免费赠送1800Gbps DDoS防御 |

梦飞科技已与全球多个国家的顶级数据中心达成战略合作关系,为互联网外贸行业、金融行业、IOT行业、游戏行业、直播行业、电商行业等企业客户等提供一站式安全解决方案。持续关注梦飞科技官网,获取更多IDC资讯!