-

日本SEO服务器如何应对爬虫和抓取工具的访问?

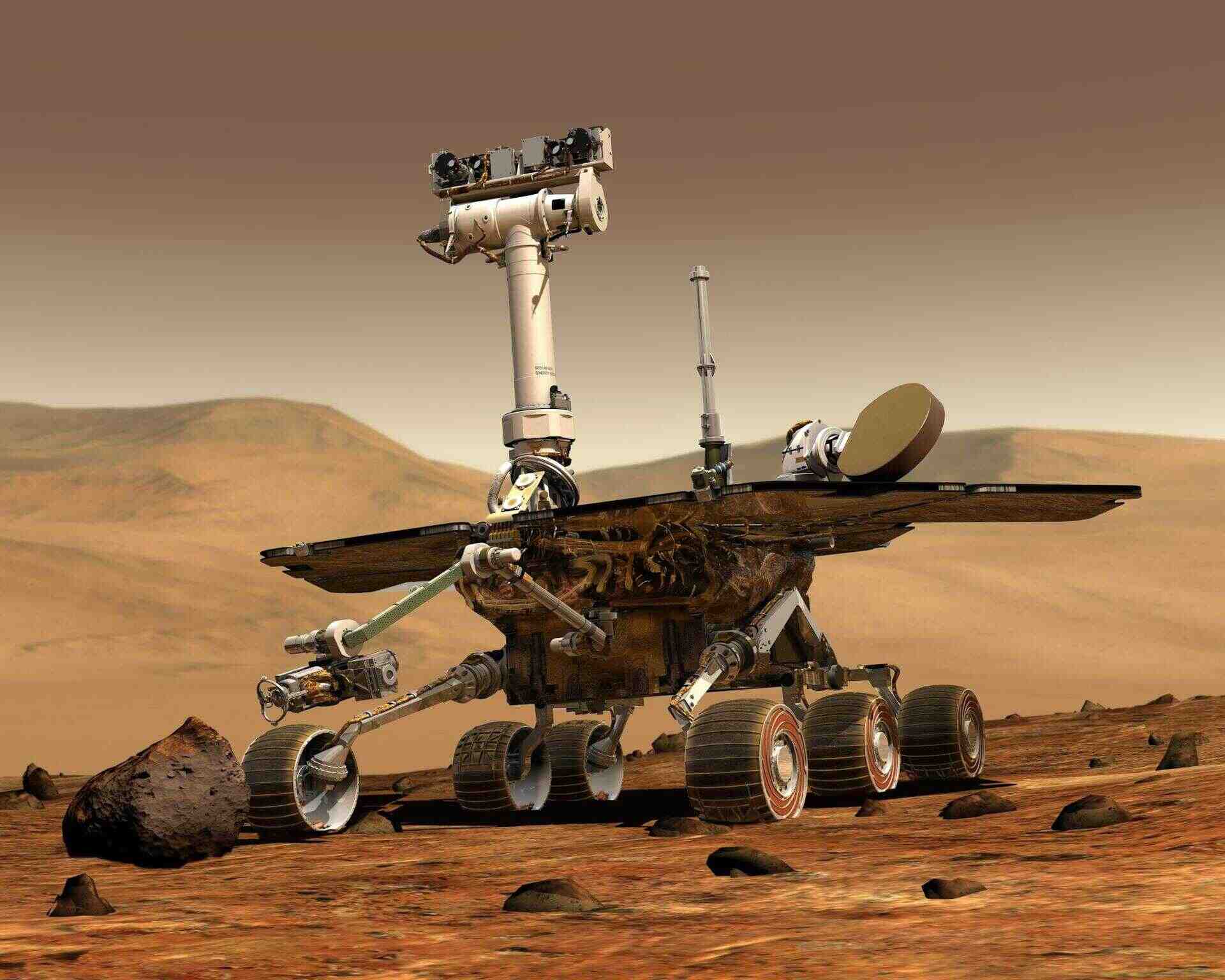

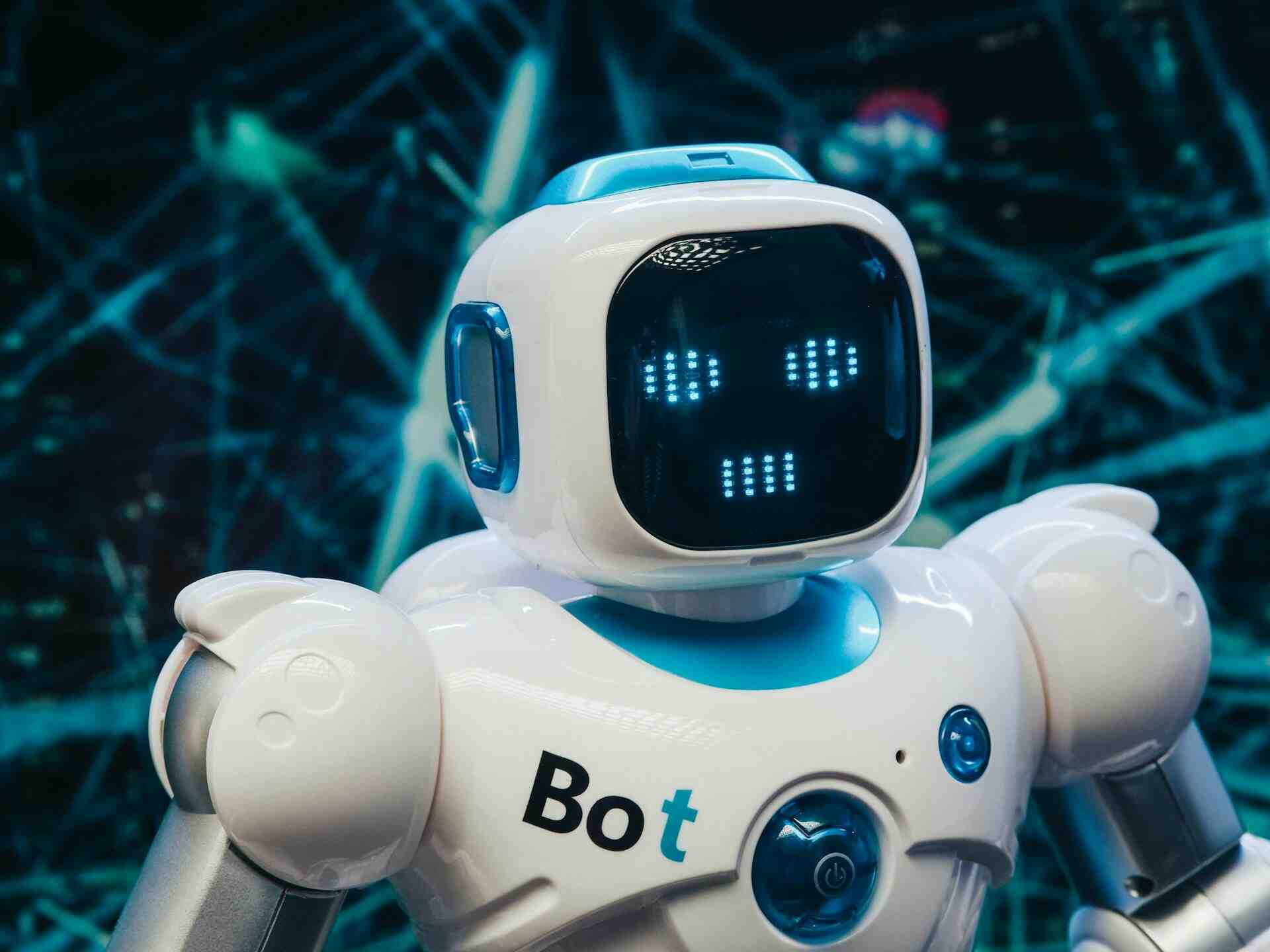

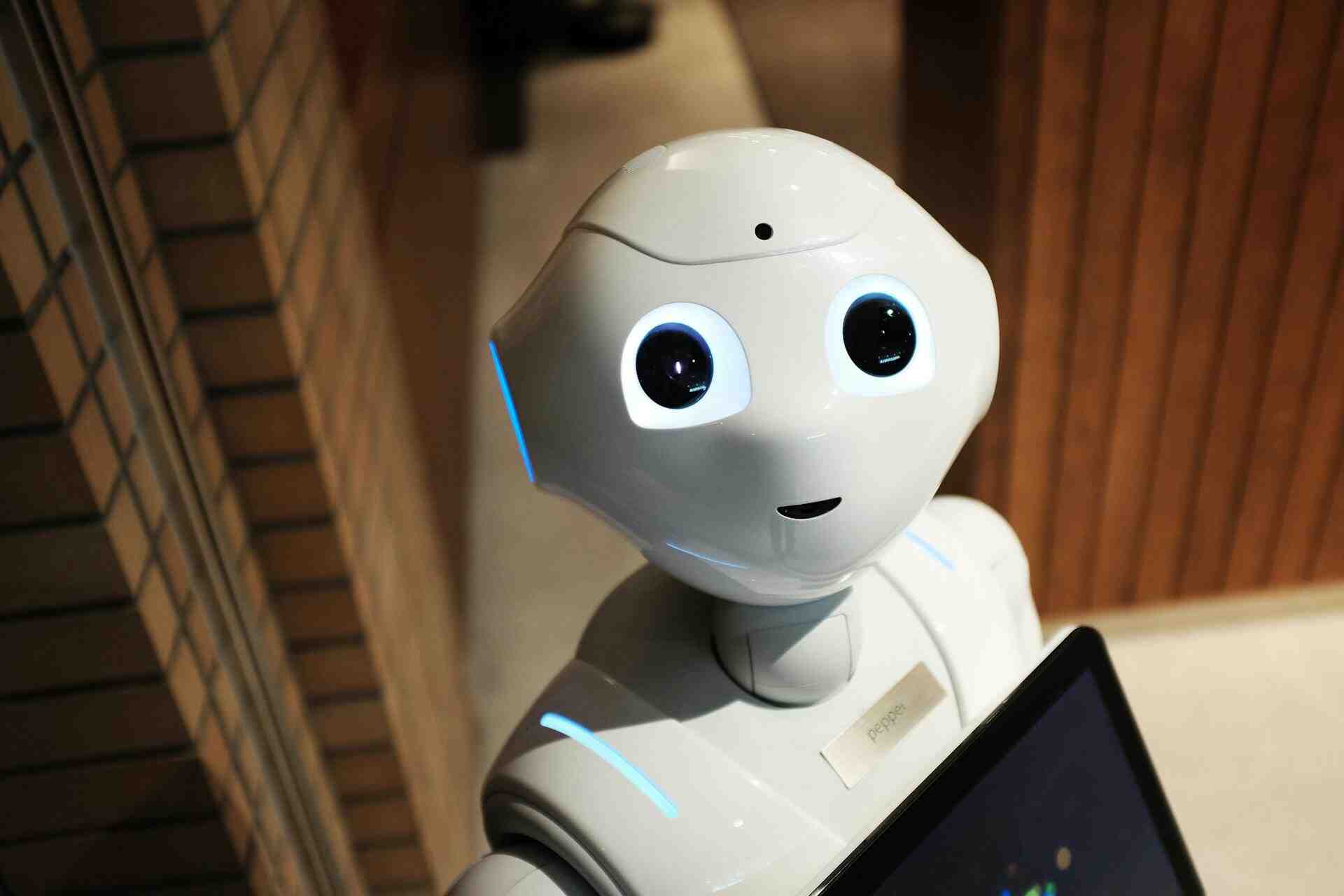

在进行SEO优化工作时,日本SEO服务器需要有效管理爬虫和抓取工具的访问,以确保搜索引擎能够正常索引网站内容。以下是一些方法和技术可以帮助服务器应对爬虫和抓取工具的访问: robots.txt文件配置:通过在网站根目录下设置robots.txt文件,管理员可以指定哪些页面可以被搜索引擎爬取,哪些页面需要被禁止访问。合理配置robots.txt文件可以控制爬虫的访问范围,提升网站的SEO效果。 ME…- 20

- 0

幸运之星正在降临...

点击领取今天的签到奖励!

恭喜!您今天获得了{{mission.data.mission.credit}}积分

我的优惠劵

-

¥优惠劵使用时效:无法使用使用时效:

之前

使用时效:永久有效优惠劵ID:×

没有优惠劵可用!